2.4 Spazio dei segnali

Esiste un modo di affrontare l’analisi dei segnali rappresentando gli stessi come elementi di uno

spazio vettoriale, estendendo così ai primi le proprietà algebriche e geometriche valide per i secondi. In questa sezione viene prima sinteticamente rivisitata la teoria degli spazi algebrici per i quali è definito un operatore di prodotto scalare, e quindi individuate le possibili corrispondenze tra le proprietà dei vettori e quelle dei segnali, riuscendo così a realizzare una sintesi unificante in relazione ai concetti di

base di rappresentazione,

ortogonalità, e

trasformazione unitaria. Si accenna infine a come molti degli integrali che sono studiati nel testo (trasformata di Fourier e di Hilbert, convoluzione, correlazione) possano essere ricondotti al calcolo di un

prodotto scalare, a sua volta associato al concetto di

operatore funzionale, ossia di funzioni che dipendono da una seconda funzione.

2.4.1 Spazio metrico

Consiste in un insieme

A di elementi (qualunque) per il quale esiste un modo per valutare la

distanza (o

metrica) tra elementi, ossia un operatore

d(x, y) che associa ad ogni coppia di elementi

x, y ϵ A un numero

reale, e per il quale

- d(x, y) ≥ 0 - nulla solo se x = y

- d(x, y) = d(y, x) - simmetria

- d(x, y) ≤ d(x, z) + d(z, y) - disuguaglianza triangolare

La distanza è un concetto topologico che permette di definire l’intorno di un punto nello spazio.

Identifica uno spazio metrico in cui il limite a cui tende una successione fa parte dell’insieme stesso. Uno spazio metrico non completo è sempre contenuto in uno spazio completo più grande, che ne costituisce il completamento, come ad esempio l’insieme dei numeri razionali è contenuto nell’insieme (completo) dei numeri reali, ottenuto dal primo con l’aggiunta dei numeri irrazionali.

2.4.2 Spazio lineare

Un insieme A di elementi viene detto spazio lineare (o spazio vettoriale) su di un campo K, quando sono definite le operazioni di somma tra elementi x, y ϵ A e di moltiplicazione degli stessi per dei coefficienti λ ∈ K, e queste due operazioni danno come risultato ancora un elemento dell’insieme, in modo che lo spazio acquisisca le proprietà di una struttura algebrica. Oltre al caso intuitivo dello spazio euclideo ℝn da cui la nozione di spazio trae origine, e quello ℂn i cui vettori sono descritti da elementi complessi, ricadono in questo caso anche lo spazio dei segnali con periodo T, quello dei segnali di energia, e quello dei segnali di potenza.

Scegliendo un

qualunque sottoinsieme

B ⊆ A di

n vettori

ui linearmente indipendenti, la combinazione lineare

dei vettori

ui con coefficienti

xi ∈ K esprime un qualunque elemento

x ϵ A purché n sia pari alla

dimensione dello spazio, ed in tal caso l’insieme

B dei vettori

ui è indicato come sua

base di rappresentazione.

Individua uno spazio vettoriale per il quale sia definita la norma (o lunghezza) ∥x∥ dei suoi elementi. Come si può verificare dalle proprietà che la definiscono

- 0 ≤ ∥x∥ < ∞ con ∥x∥ = 0 se e solo se x = 0

- ∥λx∥ = λ∥x∥ omogeneità con λ ϵ K

- ∥x + y∥ ≤ ∥x∥ + ∥y∥ disuguaglianza triangolare

la norma corrisponde alla definizione di distanza

d(x, y) data al §

2.4.1, semplicemente ponendo

d(x, y) ≐ ∥x − y∥. In tal modo lo spazio normato oltre che algebrico (perché lineare) diviene anche

metrico, con una metrica che è

indotta dalla norma; uno spazio normato che è anche completo è detto

spazio di Banach.

Per uno spazio vettoriale con un numero finito

n di dimensioni ed

isomorfo ad

ℝn si può definire norma

∥x∥p di ordine

p (con

p = 0, 1, ⋯∞) del vettore

x = x1 x2 ⋯ xn come la quantità

che per

p = 2 rappresenta una estensione del

teorema di Pitagora, mentre la distanza di ordine

p indotta tra coppie di vettori si scrive come

che nel caso

p = 2 fornisce la ben nota

distanza euclidea d2(x, y) = √∑ni = 1(xi − yi)2.

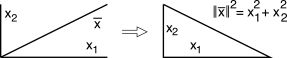

Esempio Il teorema di Pitagora stabilisce che (∥x∥)2 = x21 + x22, ossia che il quadrato costruito sull’ipotenusa è pari alla somma dei quadrati costruiti sui cateti, come in figura.

La geometria euclidea calcola la distanza tra due punti attraverso la costruzione grafica dei vettori le cui componenti sono le coordinate dei punti come in figura, e dunque z = x − y ha componenti z1 = x1 − y1 e z2 = x2 − y2.

2.4.3 Spazio prodotto interno e spazio di Hilbert

Torniamo ora indietro e ripartiamo da un generico spazio lineare definito su di un campo K reale o complesso, per il quale non è definita alcuna norma, mentre invece è definito un operatore detto prodotto scalare o prodotto interno, indicato come ⟨x, y⟩, e che associa uno scalare λ ∈ K a coppie di generici vettori x ed y in modo che

- ⟨x, y⟩ = ⟨y, x⟩* proprietà Hermitiana, ovvero commutativa se K = ℝ

- ⟨ax + by, z⟩ = a⟨x, z⟩ + b⟨y, z⟩ proprietà lineare e distributiva

- ⟨x, x⟩ ≥ 0 reale, con ⟨x, x⟩ = 0 se e solo se x = 0

da cui si ottiene che nel caso complesso deve risultare anche

⟨x, ay⟩ = a*⟨x, y⟩ detta proprietà

antilineare. Osserviamo quindi che la relazione

⟨x, x⟩ ≥ 0 può essere efficacemente utilizzata come

norma di

x, semplicemente ponendo

senza dover ricorrere a

definizioni come per la

(10.17). L’esistenza del prodotto interno pertanto

induce una norma (e dunque una

distanza) rendendo

metrico lo spazio lineare, che viene detto di

Hilbert qualora sia anche

completo; inoltre, il prodotto interno aggiunge allo spazio anche la nozione di

angolo θ tra vettori, come discutiamo ora.

Diseguaglianza di Schwartz

Esprime la relazione

ovvero

|⟨x, y⟩| ≤ ∥x∥ ⋅ ∥y∥, e quindi afferma che il prodotto interno tra vettori non è mai maggiore del prodotto delle rispettive lunghezze, eguagliandolo solo se i vettori sono proporzionali, ossia

x = αy , o in termini geometrici,

paralleli.

Dopo aver notato che dalla

(10.20) si ottiene

0 ≤ |⟨x, y⟩|∥x∥ ⋅ ∥y∥ ≤ 1, indichiamo i due estremi

0 e

1 come condizioni di

ortogonalità e

parallelismo, e dato che esiste un solo angolo

θ tale che

cosθ = |⟨x, y⟩|∥x∥ ⋅ ∥y∥ , identifichiamo

θ come l’angolo tra

x e

y, in modo che la

(10.20) possa essere letta nel consueto modo della fisica e della geometria, ovvero

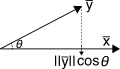

dove

∥y∥ ⋅ cosθ rappresenta la proiezione di

∥y∥ verso la direzione di

x. A parole, l’eq.

(10.21) si legge come

il prodotto scalare è pari al prodotto dei moduli per il coseno dell’angolo compreso tra i vettori, e grazie a questo nuovo risultato, possiamo affermare che

Due vettori si dicono ortogonali se il loro prodotto scalare è nullo, ossia ⟨x, y⟩ = 0.

Procediamo con l’individuare una modalità di calcolo per il prodotto scalare, restringendo per ora l’analisi al caso di spazi a dimensione n finita e isomorfi (in quanto con base ortogonale) ad uno spazio euclideo ℝn, ovvero ℂn nel caso più generale di vettori a componenti complesse.

Prodotto scalare tra vettori espressi su di una medesima base ortogonale

Come espresso dalla

(10.16) i vettori

x di uno spazio lineare

n − dimensionale

A, tanto più se di Hilbert, possono essere espressi come una combinazione lineare

x = n⎲⎳i = 1xiui

di vettori

ui ϵ B linearmente indipendenti, ovvero

B è la base di rappresentazione di

A mediante coefficienti

{xi}. Se ora aggiungiamo che tra gli elementi di

B debba sussistere la condizione di ortogonalità a coppie, ovvero

⟨ui, uj⟩ = 0 per tutti gli

i ≠ j, l’intera base è detta

ortogonale, ed i coefficienti

xi si determinano eseguendo il prodotto scalare tra

x ed ognuno di essi

Possiamo a questo punto valutare il

prodotto scalare tra coppie di vettori

x = ∑ni = 1xiui e

y = ∑ni = 1yiui con coefficienti

{xi} e

{yi} ottenuti mediante la

(10.22), nei termini del prodotto scalare tra i vettori dei coefficienti, ovvero:

Calcolo della norma su di una base ortonormale

Se i vettori

ui oltre ad essere ortogonali hanno tutti norma pari ad uno ovvero

∥ui∥2 = ⟨ui, ui⟩ = 1 essi vengono detti

unitari, la base è detta

ortonormale, e dalla

(10.23) si ottiene per il prodotto scalare tra

x e

y

mentre la norma

quadratica di un generico vettore

x si ottiene come

che corrisponde al quadrato della

(10.17) per

p = 2. Quindi, quando la base

B di rappresentazione è ortonormale, ed il prodotto interno è definito dalla

(10.24), la norma indotta

(10.25) assume la stessa forma della

(10.17) corrispondente all’ordine

p = 2, accomunando il comportamento degli spazi di Hilbert a quello noto per la geometria euclidea, in cui la base è appunto ortonormale.

Una forma più generale per indicare sia l’ortogonalità che l’unitarietà utilizza la notazione

⟨ui, uj⟩ = δi, j, in cui

δi, j è detto

delta di Kronecker che vale 1 se

i = j e zero in caso contrario. La sua versione continua è il

delta di Dirac, introdotto al §

3.4.

Notiamo infine come il prodotto scalare

⟨x, ui⟩ tra

x ed un vettore della base ortonormale sia una

proiezione ortogonale, nel senso che potendo scrivere

⟨x, ui⟩ = |x| ⋅ |ui| ⋅ cosθ (eq.

(10.21)) ed essendo

ui a lunghezza unitaria, si ottiene la lunghezza

dell’ombra del primo nella direzione del secondo.

Distanza indotta dal prodotto scalare

Si esprime come la

norma del vettore differenza ovvero applicando la

(10.25)

d(x, y) = √∥x − y∥2 = √⟨x − y, x − y⟩ = √∑ni = 1|xi − yi|2

che a sua volta corrisponde a quella di ordine

p = 2 che abbiamo definito per gli spazi euclidei (eq.

(10.18)); si ricordi che nel caso di vettori complessi risulta

|xi − yi|2 = (xi − yi)(xi − yi)* = (ℜ{xi − yi})2 + (ℑ{xi − yi})2.

Esercizio Dati due vettori complessi

x = 1 + j2, 0 e

y = 3 + j4, − j2 calcolare la norma di entrambi, e la loro distanza. Si ha

∥x∥ = √⟨x, x⟩ = √(12 + 22) + 02 = √5 e

∥y∥ = √⟨y, y⟩ = √(32 + 42) + 22 = √29; mentre

z = x − y =

1 + j2 − 3 − j4,

0 + j2 =

− 2 − j2, j2

e dunque

d(x, y) = √(22 + 22) + 22 = √12.

2.4.4 Spazi a dimensionalità infinita

I risultati a cui siamo pervenuti, e che sono stati dimostrati per spazi con un numero n finito di dimensioni, mantengono validità anche qualora detto numero divenga infinito, come per gli spazi dei segnali periodici o di energia.

Un esempio di spazio con infinite (ma numerabili) dimensioni è quello indicato come lp e descritto da un vettore le cui componenti sono elementi di una successione x = {xi} con i = 1, 2, ⋯, ∞, e per le quali la norma ∥x∥p = p√∑∞i = 1|xi|p converge ad un numero finito. La successione Xn dei coefficienti di una serie di Fourier rispecchia tale proprietà per p = 2, e la corrispondente norma quadratica (∥x∥2)2 = ∑∞i = 1|X2n| esprime la potenza di x nei termini del teorema di Parseval.

Un altro spazio ad infinite dimensioni (stavolta non numerabili) è quello Lp delle funzioni x = x(t) la cui p − esima potenza è sommabile; la norma di ordine p in questo caso viene definita come ∥x(t)∥p = ( ∫xp(t)dt)1⁄p e per p = 2 ritroviamo la classe dei segnali di energia, alla cui energia corrisponde la norma quadratica Ex = (∥x(t)∥2)2 = ∫x2(t)dt, mentre la distanza d2(x(t), y(t)) tra segnali è la radice dell’errore quadratico ∫|x(t) − y(t)|2dt.

Anche se non ci addentreremo nei dettagli analitici soggiacenti,, il tipo di equivalenze appena menzionate sono una conseguenza dell’adattare la definizione di prodotto scalare

(10.24) ai casi a dimensionalità infinita, rendendo possibile associare alle relazioni ottenibili una interpretazione geometrica unificante.

2.4.4.1 Spazio dei segnali periodici

E’ quello descritto dall’insieme dei segnali periodici di periodo

T, dato che può essere dotato di un operatore di prodotto interno tra segnali

x(t) ed

y(t) nella forma

che quando calcolato per

y(t) = x(t) permette di equiparare la

norma quadratica di

x(t) alla relativa

potenza

∥x(t)∥2 = 1T T⁄2⌠⌡ − T⁄2|x(t)|2dt

e dunque la sua norma corrisponde al relativo

valore efficace (pag.

1). Osserviamo che

- la base ortonormale di rappresentazione dei segnali periodici è costituita dai segnali un = e j2πnFt con periodo T = 1F, in quanto per essi si ha 1T ∫T⁄2 − T⁄2 e j2π(n − m)Ftdt = δn, m come ottenuto nella (10.15). Si riconosce allora che la relazione eq. (10.6) rappresenta il prodotto scalare tra il segnale ed i vettori della base (10.22), dato che dalla (10.26) si ottiene ⟨x, un⟩ = 1T ∫T⁄2 − T⁄2x(t)e −j2πnFtdt = Xn;

- l’espressione della serie di Fourier x(t) = ∑∞n = −∞Xn e j2πnFt (eq. (10.7)) costituisce la rappresentazione del segnale nei termini delle sue componenti ortogonali su base ortonormale, come espresso dalla (10.16);

- il risultato fornito dal teorema di Parseval 1T ∫T⁄2 − T⁄2|x(t)|2dt = ∑∞n = −∞|Xn|2 (eq. (10.13)) non è altro che la (10.25), ovvero il calcolo della norma quadratica come somma dei quadrati delle componenti Xn di x(t) rispetto ai vettori e j2πnFt della base.

La differenza rispetto alla trattazione generale è che ora per descrivere lo spazio occorrono infiniti (ma numerabili) vettori della base; in tal senso, lo spazio (dei segnali con periodo T) è detto separabile, che nel contesto della teoria dei segnali significa che è costituito dalle sole frequenze armoniche della fondamentale.

Una seconda conseguenza dell’ortogonalità della base costituita dagli e j2πnFt è che qualora dalla serie venga omesso qualche termine (ovvero qualche indice n) ottenendo un diverso segnale x̂(t) = ∑incompletaXn e j2πnFt, il corrispondente errore xe(t) = x(t) − x̂(t), periodico anch’esso, giace su di un sottospazio ortogonale a quello esplorato dai vettori presenti nella serie, e (si dimostra che) ha la minima norma, e dunque potenza, possibile.

2.4.4.2 Spazio dei segnali di energia e di potenza

Definizione del prodotto interno

Anche in questi due casi è possibile definire un operatore prodotto interno, che per segnali di energia prende la forma

a cui corrisponde una

norma quadratica ∥x(t)∥2 = ⟨x(t), x(t)⟩ pari

all’energia del segnale

Ex = ∥x(t)∥2 = ∫T⁄2 − T⁄2|x(t)|2dt. Per segnali

di potenza invece il prodotto scalare si scrive come

a cui corrisponde una

norma quadratica che è pari

alla potenza del segnale

Px = ∥x(t)∥2 = limT → ∞1T ∫T⁄2 − T⁄2|x(t)|2dt.

Diseguaglianza di Schwartz

La

(10.20) può essere applicata sia ai

segnali di energia che a quelli

di potenza, in quanto le relative espressioni per il prodotto interno, quando sostituite nella

(10.20), permettono di scrivere (nel caso di energia)

ovvero che il quadrato del prodotto scalare (ovvero dell’

energia mutua, §

3.2) tra segnali è sempre inferiore al prodotto delle rispettive energie (o potenze), oppure uguale nel caso in cui un segnale sia proporzionale all’altro, ovvero

x(t) = αy(t). Per il caso dei segnali di potenza valgono le stesse parole, dopo aver sostituito la

(10.29) con

|| limT → ∞ 1T T⁄2⌠⌡ − T⁄2x(t)y*(t)dt||2 ≤ limT → ∞ 1T T⁄2⌠⌡ − T⁄2|x(t)|2dt ⋅ limT → ∞ 1T T⁄2⌠⌡ − T⁄2|y(t)|2dt

Questi concetti troveranno applicazione ad es. al §

3.2 relativamente all’

energia mutua, al §

7.1.4 nel definire la

correlazione tra segnali, al §

7.6 per l’analisi del

filtro adattato... Ma lanciamoci prima su di una ulteriore speculazione, di cui tralasciamo il rigore teorico: buona parte delle relazioni affrontate nella prima parte del testo

sono una forma di prodotto interno.

2.4.4.3 Spazio dei funzionali lineari definiti da un prodotto interno

Al §

1.6 si è definito un

sistema come una trasformazione

T [.] che produce segnali di uscita in funzione di segnali di ingresso ovvero

y(t) = T [x(t)]. Dal punto di vista dell’analisi

T [.] viene pensato come un operatore o

funzionale lineare (eq.

(1.3)) che

mappa i vettori

x dello spazio

X dei segnali di ingresso, in elementi

y di uno spazio

Y di segnali di uscita, eventualmente

monodimensionale.

Qualora

X sia uno spazio di Hilbert (ossia completo e dotato di prodotto interno), allora qualunque funzionale

Tφ[x] può essere espresso nella forma di un prodotto interno

tra il vettore

x ∈ X ed un altro vettore-segnale

φ che caratterizza la trasformazione. La funzione

φ è talvolta chiamata la

funzione-kernel, il

kernel integrale o il

nucleo di una trasformazione integrale, ma non in questo testo.

Se anche

φ ∈ X l’operatore

(10.30) può fornire alcuni risultati ben noti discussi altrove nel testo. Ad esempio se

φ = x le espressioni per il prodotto scalare dei segnali

(10.27) e

(10.28) consentono di ottenere l’energia o la potenza di segnale

x; in modo simile , se

φ ≠ x si ottengono le formule per

l’energia mutua (10.35) e

l’intercorrelazione (10.155). Nell’intercorrelazione in particolare il vettore

φ che caratterizza il funzionale dipende da

due variabili

φ = φ(t, θ), in modo che il risultato del prodotto interno

⟨x(t), φ(t, θ)⟩ = ∞⌠⌡ −∞x(t)φ*(t, θ)dt = y(θ)

dipenda dalla nuova variabile

θ. Dato che stiamo portando esempi che rimandano ad argomenti trattati nei capitoli successivi, può essere opportuno tornare qui dopo aver svolto una prima fase di studio, almeno fino al cap.

7.

Prendiamo ora ad esempio il caso della

trasformata di Fourier (10.31), che calcola

X(f) = ∞⌠⌡ −∞x(t)e −j2πftdt = ⟨x(t), e j2πft⟩

e che costituisce dunque la proiezione di

x(t) nei confronti del segnale

e j2πft, che a sua volta rappresenta il vettore

φ(t, f). A ben guardare, gli esponenziali complessi costituiscono una base

ortonormale per i segnali di energia (§

3.8.5), condizione che in questo spazio è definita come

⟨φ(t, f), φ(t, λ)⟩ = δ(f − λ)

in cui

δ è un

impulso di Dirac. Da questa proprietà degli

e j2πft discende sia l’esistenza della

antitrasformata nella forma

(10.32), sia la proprietà di

unitarietà della trasformazione, ovvero di non alterare la lunghezza dei vettori nel passare dagli elementi dello spazio di segnale

X (funzione di

t) a quelli dello spazio immagine

Y (funzione di

f), e che dà luogo al teorema di Parseval.

In alcuni casi il vettore

φ che caratterizza il funzionale

(10.30) dipende da una

differenza di variabili, ovvero

φ(t, τ) = φ(t − τ)

come nell’operazione di

setacciamento (10.44), di

trasformata di Hilbert (14.26), o di

convoluzione (10.48): in quest’ultimo caso

φ(t, τ) = h(t − τ) è direttamente legato alla

risposta impulsiva h(t) che caratterizza completamente il

sistema.

Se aver verificato che una convoluzione e dunque

un filtro corrisponde ad un prodotto scalare e quindi ad un funzionale ovvero

un sistema non ci è bastato, allarghiamo il discorso aggiungendo il fatto che l’insieme dei funzionali

Tφ che operano su di un medesimo spazio di Hilbert

X di ingresso costituisce

esso stesso uno spazio di Hilbert, detto

spazio duale X*, in cui la norma è definita come

∥Tφ∥ = ∥φ∥ = √⟨φ, φ⟩

e se

∥φ∥ < ∞ il funzionale è

continuo. Se inoltre

X possiede una base

ortonormale {ui(t)} mediante la quale rappresentare i suoi vettori come

x(t) = ∑ni = 1xiui(t) in cui

xi = ⟨x(t), ui(t)⟩, allora i funzionali di

X* possono

a loro volta essere rappresentati come una combinazione lineare di vettori-segnali.

Un modo diretto di procedere esprime il

segnale di uscita y(θ) = Tφt, θ[x(t)] come

y(θ) = n⎲⎳i = 1xiTφt, θ[ui(t)] = n⎲⎳i = 1xivi(θ)

in cui

vi(θ) è il risultato del funzionale

Tφ applicato ai vettori della base

ui(t) di

X, che dunque opera sommando i suoi

vettori di risposta vi(θ) (che appartengono a

Y) con pesi pari alle componenti

xi di

x(t) proiettate sugli

ui(t).

Esempio L’integrale di convoluzione

y(t) = ∫∞−∞x(τ) h(t − τ) dτ esprime l’uscita

y(t) come combinazione lineare delle

h(t − τ) effetto degli impulsi

δ(t), che costituiscono una base ortonormale per

x(t) nei termini espressi dalla proprietà di setacciamento

x(t) = ∫∞−∞x(τ)δ(t − τ)dτ, vedi §

3.4.

Non è però detto che

{vi(θ)} formi una base di vettori linearmente indipendenti per lo spazio di uscita

Y; poniamo allora di conoscere una base ortonormale

{ũi(θ)} per lo spazio

Y (): in tal caso esiste un insieme di

n vettori

{zi(t) ∈ X} che dipende sia da

{ũi(θ)} che da

{ui(t)} e dalla sua trasformata

{vi(θ)}, e che individua altrettanti funzionali

Tzi[x(t)] = ⟨x(t), zi(t)⟩ in modo da poter scrivere

y(θ) = n⎲⎳i = 1⟨x(t), zi(t)⟩ũi(θ) = n⎲⎳i = 1 Tzi[x(t)]ũi(θ)

decomponendo quindi

Tφ in

n funzionali dipendenti dalla scelta delle basi.